Qzone

Qzone

微博

微博

微信

微信

日前,阿里云通义千问方面宣布开源320亿参数模型Qwen1.5-32B系列,包括Qwen1.5-32B-Base模型和Qwen1.5-32B-Chat模型。

据了解,作为Qwen1.5模型系列的最新成员,除了GQA,Qwen1.5-32B在模型架构上和Qwen1.5系列其他模型并无差异。而GQA能让Qwen1.5-32B在提供模型服务时具有更高的推理效率潜力,在性能、效率和内存占用之间实现了更理想的平衡。例如相比通义千问14B开源模型,其在智能体场景下能力更强,而相比通义千问72B开源模型的推理成本则更低。

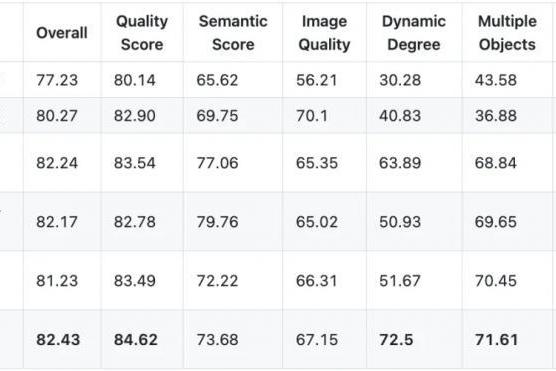

据阿里云通义千问方面公布的测试结果显示,在基础能力层面,Qwen1.5-32B在MMLU、GSM8K、HumanEval以及BBH等多种任务上的表现虽然与720亿参数模型相比略有逊色,但优于其他300亿参数级别模型(Llama2-34B、Mixtral-8×7B)。

在Chat模型层面,阿里云通义千问方面遵循Qwen1.5的评估方案,还测试了Qwen1.5-32B-Chat在MT-Bench与Alpaca-Eval2.0上的表现。结果显示,Qwen1.5-32B-Chat模型得分超过8分,与Qwen1.5-72B-Chat之间的差距相对较小。

在多语言能力层面,阿里云通义千问方面选取了包括阿拉伯语、西班牙语、法语等在内的12种语言,在考试、理解、数学及翻译等多个领域做了评测。结果显示,Qwen1.5-32B具备出色的多语言能力,表现仅略逊于72B模型。此外,阿里云通义千问方面还测试了Qwen1.5-32B-Chat在长文本评估任务中的表现,结果显示,该模型在长达32K tokens的上下文中表现优秀。

对此阿里云方面表示,“我们期望Qwen1.5-32B的发布能帮助用户为下游应用找到更优的解决方案,以应对14B模型在智能体场景下能力偏弱、72B模型推理成本过高等问题”。

值得一提的是,至此阿里云通义千问方面已相继开源包括5亿、18亿、40亿、70亿、140亿、320亿、720亿参数规模在内的7款大模型,并在海内外开源社区的累计下载量已突破300万。

对此阿里云CTO周靖人曾指出,“开源生态对促进中国大模型的技术进步与应用落地至关重要,通义千问将持续投入开源,希望成为‘AI时代最开放的大模型’,与伙伴们共同促进大模型生态建设”。

【以上内容转自“三易生活网”,不代表本网站观点。如需转载请取得三易生活网许可,如有侵权请联系删除。】

延伸阅读:

TOM2025-02-23 19:5002-23 19:50

TOM2025-02-23 19:4902-23 19:49

TOM2025-02-23 19:4902-23 19:49

TOM2025-02-23 19:4202-23 19:42